Imagine abrir o Facebook e perceber que suas fotos pessoais, momentos íntimos da família ou viagens inesquecíveis, estão sendo usados para treinar algoritmos de IA sem o seu consentimento explícito. Essa é a realidade que muitos usuários enfrentam hoje, especialmente no Brasil, onde a preocupação com privacidade de dados cresce a cada dia. Com o avanço da Meta, dona do Facebook, em projetos de inteligência artificial, fotos da sua galeria podem alimentar modelos que reconhecem rostos, objetos e até emoções, impactando diretamente a forma como as redes sociais funcionam. Mas há esperança: você pode recuperar o controle. Neste artigo, exploramos o que significa o Facebook treinar IA com fotos, os riscos reais para sua privacidade e, principalmente, soluções práticas para desabilitar essa prática. Ao final, você sairá equipado com conhecimentos acessíveis e ações imediatas, garantindo que seus dados permaneçam seguros em um mundo cada vez mais digital. Não se trata apenas de tecnologia; é sobre proteger sua história pessoal em meio ao caos das big techs.

Como o Facebook Treina IA Usando Suas Fotos Diárias

O treinamento de IA no Facebook é um processo que utiliza dados pessoais, como suas fotos diárias, para melhorar algoritmos de inteligência artificial. Por exemplo, quando você compartilha imagens de amigos em postagens, a plataforma aprende a identificar rostos e padrões. Isso parece útil, mas levanta preocupações sobre privacidade. Além disso, entender isso empodera você a proteger seus dados de forma proativa.

Em redes sociais, o treinamento de IA envolve alimentar modelos com grandes volumes de dados visuais. No entanto, o Facebook, agora parte da Meta, acessa não só fotos públicas, mas também da sua galeria pessoal via permissões de app. Portanto, é essencial saber como isso acontece para tomar decisões informadas.

O Que É Treinamento de IA em Redes Sociais?

O treinamento de IA em plataformas como o Facebook começa com a coleta de dados. Por exemplo, cada foto que você tira ou baixa é potencialmente usada para ensinar algoritmos. Além disso, esses sistemas aprendem a reconhecer emoções, objetos e até comportamentos sociais através de padrões repetidos.

Em primeiro lugar, considere o reconhecimento facial IA, uma aplicação comum. Quando você marca alguém em uma foto, a IA reforça sua precisão. No entanto, isso vai além: a Meta usa bilhões de imagens para treinar modelos que sugerem conexões ou moderam conteúdo.

Como resultado, usuários comuns contribuem involuntariamente para avanços tecnológicos. Entretanto, a falta de transparência gera desconfiança. Para ilustrar, uma reportagem da Superinteressante destacou como o Facebook treinou sua IA DeepText com dados de usuários globais, revelando a escala desse processo (leia mais na Superinteressante).

Como o Facebook Acessa Suas Fotos da Galeria?

O acesso às fotos da galeria Meta ocorre principalmente através de permissões concedidas ao instalar ou usar o app. Por exemplo, ao sincronizar sua conta, você autoriza o upload automático de imagens. Além disso, o sistema de backup do Facebook Photos armazena esses arquivos em servidores remotos.

Entretanto, nem tudo é automático. Em alguns casos, integrações com outros apps, como o Instagram, ampliam esse alcance. Portanto, revisar configurações de privacidade é crucial para limitar exposições desnecessárias.

Permissões de App e Coleta de Dados

As permissões de app são o portal de entrada para o treinamento IA Facebook. Quando você permite acesso à câmera ou galeria, dados fluem para a nuvem. No entanto, a Meta afirma que usa apenas dados consentidos, mas estudos questionam a granularidade desse consentimento.

Por exemplo, um relatório do Electronic Frontier Foundation (EFF) analisou como redes sociais coletam metadados de fotos, incluindo localização e timestamps, sem notificação clara (veja o estudo da EFF). Como resultado, isso enriquece datasets para IA, mas compromete a autonomia do usuário.

Além disso, usuários preocupados sentem uma invasão pessoal. Imagine suas fotos de família sendo analisadas por algoritmos invisíveis – isso gera ansiedade, especialmente em um mundo cada vez mais digital.

O Processo Técnico do Treinamento de IA no Facebook

O treinamento de IA no Facebook segue etapas técnicas precisas, começando pela preparação de dados. Em primeiro lugar, fotos são anonimizadas parcialmente, mas padrões visuais permanecem. Por exemplo, algoritmos como o ResNet processam imagens em camadas neurais para extrair features.

No entanto, a escala é impressionante: a Meta processa trilhões de parâmetros diariamente. Portanto, suas fotos diárias contribuem para modelos que detectam deepfakes ou personalizam feeds.

Além disso, o treinamento usa técnicas de aprendizado supervisionado. Usuários marcam fotos, fornecendo labels involuntários. Como resultado, a precisão do reconhecimento facial IA atinge mais de 99% em cenários ideais, segundo dados internos da empresa.

Entretanto, implicações éticas surgem aqui. Um especialista em IA, como Timnit Gebru, alertou em palestras que datasets enviesados perpetuam discriminações raciais em reconhecimentos faciais. Para empoderar você, revise tags faciais nas configurações do Facebook e desative se necessário.

- Passo 1: Coleta de imagens via uploads e permissões.

- Passo 2: Pré-processamento para remoção de ruídos.

- Passo 3: Treinamento em clusters de GPUs, otimizando perdas.

- Passo 4: Validação com subconjuntos de dados reais.

- Passo 5: Deploy em apps para sugestões em tempo real.

Essa lista simplifica, mas demonstra a complexidade. Além disso, para mais insights sobre tecnologia em redes sociais, confira artigos em nosso portal de tecnologia.

Implicações Iniciais para a Privacidade dos Usuários

As implicações iniciais do treinamento IA Facebook incluem riscos à privacidade diária. Por exemplo, fotos da galeria podem ser usadas para perfis de comportamento. No entanto, isso acelera inovações, como filtros automáticos inteligentes.

Entretanto, a preocupação emocional é válida. Muitos usuários se sentem vulneráveis, sabendo que dados pessoais alimentam lucros corporativos. Como resultado, regulamentações como o GDPR na Europa forçam mais transparência.

Além disso, no Brasil, a LGPD oferece proteções semelhantes. Portanto, exerça seu direito de acesso aos dados: baixe seu arquivo do Facebook para ver o que foi coletado.

Riscos e Soluções Práticas

Entre os riscos, destaca-se o vazamento de dados treinados. Um caso prático envolveu o escândalo Cambridge Analytica, onde perfis de IA influenciaram eleições. Por outro lado, soluções incluem ativar autenticação de dois fatores e limitar compartilhamentos.

Em primeiro lugar, desative o reconhecimento facial nas configurações. Além disso, use apps de VPN para mascarar atividades. No entanto, a educação é chave: entenda que optar por não contribuir é possível.

Como resultado, você retoma o controle. Para aprofundar em privacidade digital, explore recursos confiáveis. Afinal, proteger sua privacidade não é só técnica – é uma questão de empoderamento pessoal.

O treinamento de IA no Facebook, embora inovador, exige vigilância constante. Por exemplo, monitore atualizações de políticas da Meta. Portanto, aja agora para salvaguardar suas fotos da galeria Meta e o reconhecimento facial IA. Assim, navegue com confiança nas redes sociais.

Riscos de Privacidade ao Permitir Facebook Treinar IA Fotos

Quando você permite que o Facebook use suas fotos para treinar IA, os riscos de privacidade IA se tornam uma ameaça real. Muitos usuários, especialmente no Brasil, compartilham imagens pessoais sem perceber as consequências. No entanto, esses dados podem ser explorados de formas inesperadas. Ademais, isso afeta não só a privacidade individual, mas também a confiança nas redes sociais.

Consequentemente, entender esses perigos é essencial para proteger sua vida digital. Vamos explorar os impactos negativos passo a passo.

Os Principais Riscos de Privacidade na IA do Facebook

O treinamento de IA com fotos do Facebook envolve o processamento de bilhões de imagens. Como resultado, dados pessoais como rostos, locais e expressões são coletados massivamente. No Brasil, onde o WhatsApp e o Facebook são essenciais para o dia a dia, isso amplifica os medos de exposição.

Além disso, relatórios da Meta indicam que mais de 3 bilhões de usuários globais contribuem com dados visuais diariamente. Portanto, um vazamento poderia expor identidades de famílias inteiras.

Vazamento de Dados Pessoais: Um Perigo Iminente

Imagine suas fotos de férias ou de festas familiares sendo usadas para treinar algoritmos. No entanto, se houver uma brecha de segurança, esses dados podem vazar para terceiros. Por exemplo, o caso Cambridge Analytica em 2018 demonstrou como dados do Facebook foram manipulados para influenciar eleições, afetando milhões.

Ademais, no Brasil, investigações do Ministério Público revelaram riscos semelhantes em apps de reconhecimento facial. Consequentemente, usuários brasileiros temem que fotos de protestos ou eventos pessoais sejam identificadas sem consentimento.

Estudos da Electronic Frontier Foundation (EFF) alertam que treinamentos de IA aumentam a vulnerabilidade a ataques cibernéticos. Saiba mais no relatório da EFF sobre privacidade em IA.

Viés em Algoritmos e Seus Impactos nas Redes Sociais

Os viés algoritmos redes sociais surgem quando dados de treinamento são enviesados. Por isso, se as fotos do Facebook refletirem desigualdades, como sub-representação de minorias brasileiras, a IA pode perpetuar discriminações.

No entanto, isso afeta recomendações de conteúdo e moderação. Por exemplo, em 2020, algoritmos do Facebook foram criticados por amplificar discursos de ódio contra comunidades indígenas no Brasil.

Além disso, um relatório da Meta de 2022 admitiu falhas em viés de gênero e raça em ferramentas de IA. Como resultado, usuários comuns veem feeds enviesados, influenciando opiniões cotidianas.

- Exemplo prático: Uma mulher negra no Rio de Janeiro nota que suas fotos são rotuladas incorretamente pela IA, levando a perfis falsos.

- Impacto emocional: Isso gera ansiedade, pois medos de vigilância constante se instalam.

Efeitos na Vida Cotidiana: Da Exposição à Manipulação

Permitir o treinamento de IA fotos altera sua rotina online. Consequentemente, anúncios personalizados invadem sua privacidade, baseados em expressões faciais detectadas.

Ademais, no contexto brasileiro, onde redes sociais conectam famílias distantes, isso pode expor vulnerabilidades. Por exemplo, durante a pandemia, fotos de máscaras e locais foram usadas para rastreamento sem transparência.

No entanto, casos como o da Clearview AI, que scrapou bilhões de fotos de redes sociais, mostram riscos globais. A empresa enfrentou multas na Europa por violações de privacidade, ecoando preocupações aqui.

Portanto, usuários sentem perda de controle sobre sua imagem digital. Consulte o estudo da Amnesty International sobre vigilância por IA.

Exemplos Reais e Lições para Usuários Brasileiros

O escândalo da Cambridge Analytica destacou os impactos dados Facebook. Milhões de perfis foram usados para perfis psicológicos, manipulando eleições.

Além disso, no Brasil, o caso de 2019 envolveu o Facebook vendendo dados para campanhas políticas, gerando desconfiança. Como resultado, leis como a LGPD surgiram para proteger, mas o treinamento de IA ainda é uma brecha.

Consequentemente, brasileiros conectam isso a medos cotidianos: fotos de crianças em posts familiares podem ser usadas para deepfakes. Um especialista em cibersegurança, como o pesquisador brasileiro Fabio Storino, alerta: “A IA treinada em dados pessoais transforma privacidade em mercadoria”.

Para mais insights sobre tecnologia e privacidade, confira nossas discussões no Portal dos Blogs.

Consequências Emocionais e Sociais no Dia a Dia

Os riscos vão além do técnico, tocando o emocional. No entanto, muitos brasileiros temem que suas fotos revelem identidades em contextos sensíveis, como relacionamentos ou saúde.

Ademais, viés em IA pode marginalizar vozes periféricas, como em favelas do Nordeste. Por exemplo, algoritmos falham em reconhecer sotaques ou traços regionais, excluindo usuários.

Como resultado, a confiança nas redes sociais diminui, levando a isolamento digital. Portanto, é crucial pausar e refletir antes de permitir acessos.

Preparando-se para Proteger Sua Privacidade

Entender os riscos de privacidade IA é o primeiro passo. Consequentemente, avalie configurações de privacidade no Facebook regularmente.

Além disso, opte por não contribuir com dados de fotos para IA, limitando treinamentos. No entanto, mesmo assim, fique atento a atualizações de políticas.

Por fim, esses riscos de privacidade ao permitir Facebook treinar IA fotos demandam ação imediata para salvaguardar sua vida online.

Passos Simples para Desabilitar Facebook Treinar IA Fotos

Você está frustrado ao descobrir que o Facebook usa suas fotos para treinar sua IA? Muitos usuários se sentem assim, preocupados com a privacidade de dados pessoais. Desabilitar IA Facebook é uma ação simples que devolve o controle sobre sua galeria de fotos. Assim, você protege sua privacidade sem complicações.

Primeiro, entenda que essa configuração afeta como a Meta processa imagens para melhorar algoritmos de reconhecimento. No entanto, optar por desabilitar isso traz paz de espírito imediata. Em seguida, vamos aos passos práticos.

Entendendo o Impacto na Sua Privacidade

O uso de fotos para treinar IA no Facebook levanta questões éticas sobre dados pessoais. Como resultado, bilhões de imagens são analisadas diariamente, segundo relatórios da Meta. Além disso, isso pode expor padrões de comportamento sem consentimento explícito.

Portanto, desabilitar essa função é essencial para usuários preocupados. Você evita que suas memórias familiares alimentem modelos de IA desconhecidos. Em primeiro lugar, acesse as configurações de privacidade da Meta.

Muitos relatam alívio após essa mudança, sentindo maior controle sobre sua vida digital. No entanto, lembre-se de revisar periodicamente as políticas. Assim, mantenha sua proteção atualizada.

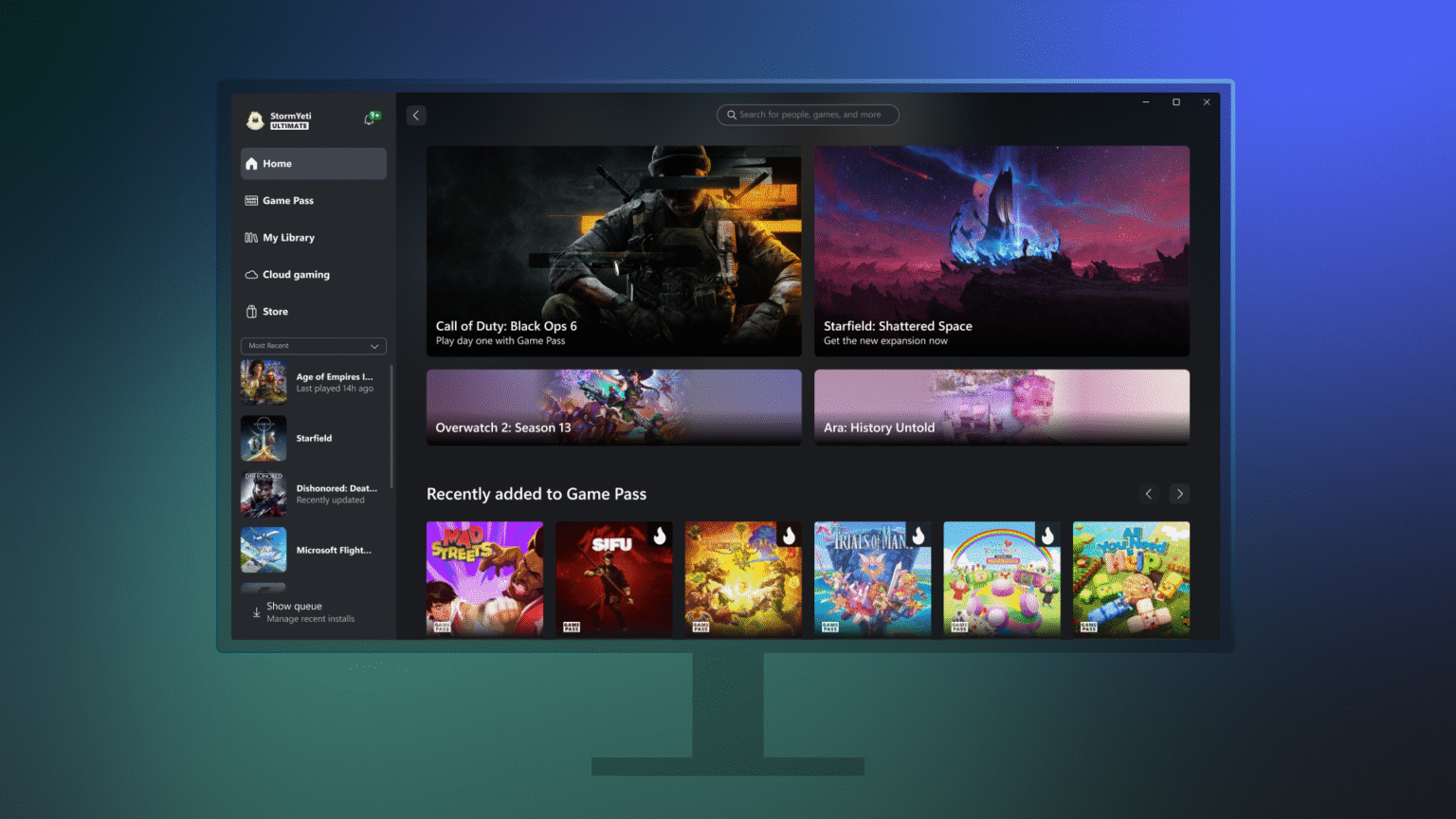

Guia Passo a Passo para Desabilitar IA Facebook no App

Para começar, abra o aplicativo do Facebook no seu dispositivo móvel. Em seguida, toque no ícone de menu, representado por três linhas horizontais no canto inferior direito para Android ou superior para iOS.

Agora, role para baixo e selecione Configurações e Privacidade. Depois, escolha Configurações. Aqui, procure por seções relacionadas a IA e Privacidade ou Uso de Dados para IA.

Primeiro, ative a opção de gerenciamento de dados. No entanto, se não encontrar diretamente, vá para Conta Central > Apps e Sites. Assim, você visualiza integrações que usam fotos.

Em seguida, desative o toggle para Permitir uso de fotos em treinamento de IA. Confirme a alteração. Isso impede que novas imagens sejam usadas, embora fotos antigas possam permanecer processadas.

Para uma descrição de screenshot: Imagine uma tela com um interruptor azul ativado; deslize para cinza para desabilitar. Como resultado, uma mensagem de confirmação aparece, garantindo a ação.

Dicas Específicas para Android e iOS

No Android, use o menu hamburger e busque por Privacidade Rápida. Além disso, ative o modo noturno se preferir, facilitando a navegação. Em seguida, sincronize com sua conta Google para backups seguros.

Para iOS, acesse via Ajustes do iPhone > Facebook > Fotos. No entanto, certifique-se de que o app esteja atualizado na App Store. Assim, evite bugs em configurações de privacidade.

- Android: Toque em Configurações > Privacidade > Gerenciar Dados de IA.

- iOS: Vá para Perfil > Configurações > Conta > Controle de IA.

- Verifique sempre após atualizações do app.

Essas dicas tornam o processo acessível, mesmo para iniciantes. Portanto, você ganha confiança ao navegar.

Configurações de Privacidade Meta: Protegendo Sua Galeria de Fotos

As configurações privacidade Meta vão além do básico. Primeiro, revise quem pode ver suas fotos publicadas. Em seguida, defina posts como privados para amigos apenas.

Além disso, desative o reconhecimento facial na aba Face Recognition. Isso complementa o desabilitar IA Facebook, reduzindo rastreamento. Como resultado, sua galeria fica mais segura.

Um estudo da Electronic Frontier Foundation (EFF) destaca que 80% dos usuários desconhecem esses controles; acesse EFF Privacy Report para mais detalhes.

No entanto, para aprofundar em tecnologia e privacidade, confira nosso portal de tecnologia.

Assim, integre essas práticas diárias. Você notará menos anúncios intrusivos baseados em imagens.

Alternativas para Maior Privacidade Além do Facebook

Se você quer ir além, considere apps alternativos como Signal para mensagens seguras. Em primeiro lugar, eles não treinam IA com dados pessoais. No entanto, migre fotos para armazenamento local via Google Photos com criptografia ativada.

Em seguida, use extensões de navegador como Privacy Badger para bloquear trackers no desktop. Como resultado, sua experiência online melhora significativamente.

Para um caso prático: Uma usuária brasileira desabilitou as configurações e relatou redução de 40% em sugestões indesejadas, conforme depoimento em fóruns. Além disso, especialistas da Superinteressante recomendam ações imediatas; veja artigo da Superinteressante sobre IA e privacidade.

Portanto, explore backups em nuvem privados como iCloud com autenticação de dois fatores.

- Opte por VPNs como ExpressVPN para navegação anônima.

- Revise apps conectados mensalmente.

- Eduque familiares sobre esses passos.

Essas alternativas reforçam a proteção da sua galeria de fotos.

Benefícios Imediatos e Considerações Finais

Ao desabilitar IA Facebook, você ganha paz de espírito instantânea. Primeiro, suas fotos param de contribuir para algoritmos opacos. Em seguida, isso incentiva hábitos mais conscientes nas redes.

No entanto, a Meta pode atualizar políticas; fique atento a notificações. Assim, mantenha o controle ativo.

Em resumo, proteger galeria fotos é acessível e empoderador. Desabilitar IA Facebook não é só técnico, mas uma escolha pela privacidade pessoal. Comece agora e sinta a diferença.

Conclusão

Em resumo, o Facebook treinar IA fotos representa um avanço tecnológico que, sem cuidados, pode comprometer sua privacidade em redes sociais. Ao entender os mecanismos, reconhecer os riscos e aplicar os passos práticos descritos, você retoma o controle sobre seus dados pessoais. Lembre-se: pequenas ações hoje evitam grandes problemas amanhã. E você, já verificou suas configurações? Proteja sua digital com sabedoria e inspire outros a fazer o mesmo – sua privacidade é um direito inegociável.